Jak prowadzić realistyczne symulacje rozmów online bez łamania granic

Kiedy ostatnio rozmawiałeś z kimś, kto był tylko… algorytmem? Może nawet nie zauważyłeś różnicy. W świecie, gdzie granica między człowiekiem a maszyną coraz bardziej się zaciera, pytanie „jak prowadzić realistyczne symulacje rozmów online” przestaje być branżową ciekawostką, a staje się brutalnym wyzwaniem XXI wieku. To nie jest kolejny entuzjastyczny poradnik o chatbotach. Prześwietlamy fakty, rozbieramy mity na części pierwsze i pokazujemy, gdzie naprawdę tkwi potencjał, a gdzie niebezpieczne złudzenie. Ten tekst to Twój przewodnik po świecie symulowanych konwersacji: od historii pierwszych cyfrowych gadaczy, przez dzisiejsze platformy takie jak gwiazdy.ai, po kontrowersje i ostrzeżenia, które każdy świadomy użytkownik powinien znać. Sprawdź, co działa, co zawodzi i co wymaga Twojej czujności. Oto przewodnik, który powstał po to, byś nie dał się nabrać—i wiedział, jak wyciskać z technologii maksimum, nie tracąc z oczu tego, co naprawdę ludzkie.

Dlaczego realizm w symulacji rozmów to obsesja XXI wieku

Krótka historia cyfrowej rozmowy: od Elizy do gwiazdy.ai

Zanim zaczniemy rozkładać na czynniki pierwsze, jak prowadzić realistyczne symulacje rozmów online, trzeba wrócić do źródeł. Wszystko zaczęło się w 1966 roku, kiedy Joseph Weizenbaum zaprezentował program ELIZA—pierwszego chatbota, który udawał psychoterapeutę, bazując na prostym dopasowywaniu słów kluczowych [Laerdal, 2022]. ELIZA nie rozumiała rozmówców, ale wywołała szok swoim „realizmem”. Sześć lat później PARRY próbował symulować schizofrenika, a świat powoli oswajał się z myślą, że cyfrowa rozmowa nie musi być drewniana.

Przeskakujemy do XXI wieku. Rok 2023 to moment, gdy ChatGPT (GPT-4) zaczyna rozumieć niuanse kontekstu na niespotykaną dotąd skalę. W Polsce i na świecie pojawiają się platformy, które idą o krok dalej—jak gwiazdy.ai, umożliwiające prowadzenie realistycznych rozmów z wirtualnymi wersjami znanych osobistości, tworzonych przez zaawansowane modele AI. Ta transformacja nie jest przypadkiem. Stoi za nią obsesja na punkcie naturalności i autentyczności, która ogarnęła nie tylko branżę technologii.

| Rok | Przełomowy chatbot / platforma | Kluczowy postęp |

|---|---|---|

| 1966 | ELIZA | Dopasowanie słów kluczowych, symulacja rozmówcy |

| 1972 | PARRY | Symulacja zaburzeń psychicznych |

| 2023 | ChatGPT (GPT-4) | Zrozumienie kontekstu, dynamiczne odpowiedzi |

| 2024-2025 | gwiazdy.ai, AIMojo | Integracja AI z realnymi doświadczeniami użytkowników |

Tabela 1: Najważniejsze kamienie milowe w rozwoju symulacji rozmów online. Źródło: Opracowanie własne na podstawie Laerdal (2022), KreatorzyKariery.pl, AIMojo (2024).

Czego (nie) rozumiemy przez 'realistyczność'? Techniczne i społeczne definicje

Realistyczność w symulacji rozmów online to pojęcie, które pęka w szwach od sprzeczności. Technicznie—chodzi o to, by AI brzmiała, myślała i reagowała jak człowiek. Ale społecznie, to znacznie więcej: oczekujemy nieprzewidywalności, emocji, a nawet błędów, które są przynależne ludzkiemu doświadczeniu [Laerdal, 2022].

Odnosi się do precyzji odtwarzania języka naturalnego, stylu wypowiedzi i umiejętności AI do rozpoznawania kontekstu.

Obejmuje nie tylko język, ale też symulację emocji, autentyczną reakcję na nieprzewidywalne pytania i umiejętność prowadzenia dialogu z błędami czy rozbieżnościami—typowymi dla prawdziwego człowieka.

W praktyce oznacza to, że „realistyczność” to nie cel sam w sobie, a efekt splotu technologii, kultury i oczekiwań. Dla jednych ważna jest płynność interakcji, dla innych – autentyczne odczucia czy nawet możliwość „wyczucia” osobowości rozmówcy, nawet jeśli tym rozmówcą jest algorytm.

Dlaczego Polacy coraz częściej testują symulacje rozmów

Polska nie pozostaje w tyle. Według raportów branżowych, coraz więcej osób sięga po symulatory rozmów—zarówno do celów rozrywkowych, jak i edukacyjnych [KreatorzyKariery.pl, 2024].

- Chęć sprawdzenia siebie w trudnych sytuacjach, np. podczas rozmów kwalifikacyjnych.

- Rozwijanie kompetencji miękkich bez ryzyka kompromitacji na żywo.

- Potrzeba natychmiastowej informacji zwrotnej i analizy nagrań.

- Pragnienie anonimowości – AI nie ocenia, nie plotkuje.

- Rosnące zaufanie do AI oraz łatwa dostępność narzędzi jak gwiazdy.ai czy AIMojo.

"Realizm zwiększa efektywność nauki i zaangażowanie użytkowników, bo pozwala lepiej przygotować się na realne wyzwania."

— Laerdal, 2022

Warto dodać, że motywacje Polaków są bardzo różnorodne – od pragmatycznych (chęć zdobycia pracy) po czysto ciekawskie („czy AI da się zagiąć?”). To pokazuje, że symulacja rozmowy to nie tylko gadżet, ale narzędzie do realnych zmian.

Najczęstsze mity o realistycznych symulacjach rozmów — rozbijamy je na kawałki

Mit 1: Im bardziej AI gada jak człowiek, tym lepiej

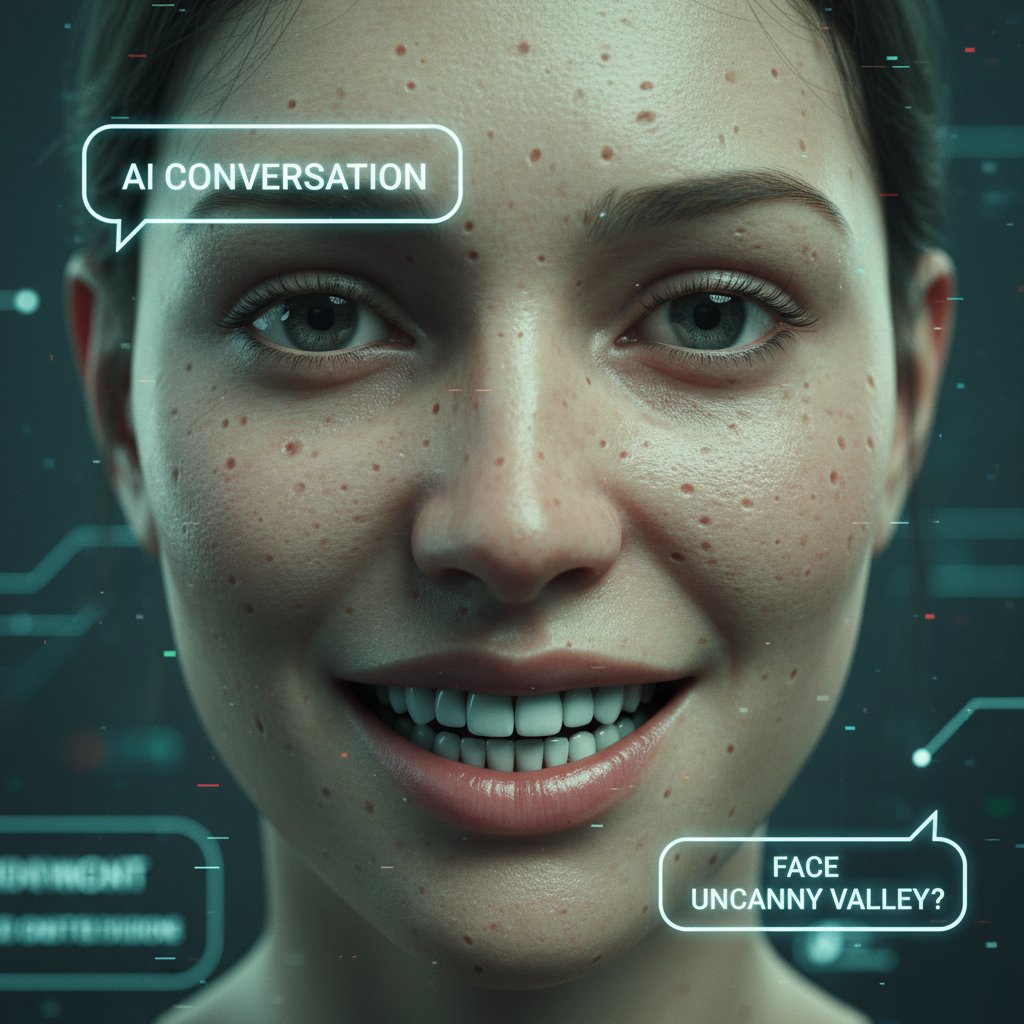

Powszechne przekonanie głosi, że im bardziej AI przypomina człowieka, tym lepszy efekt symulacji. To prosta droga do rozczarowania. Liczne badania pokazują, że przesadna „człowieczość” prowadzi do efektu uncanny valley—a więc zamiast zachwytu mamy niepokój, a czasem nawet odrzut [Laerdal, 2022].

"Ironią jest, że im bardziej AI stara się być człowiekiem, tym bardziej użytkownik czuje dyskomfort – to nie działa na dłuższą metę." — Dr. Tomasz Szlendak, socjolog, Laerdal, 2022

To nie płynność, a autentyczność reakcji oraz umiejętność przyznania się do niewiedzy buduje zaufanie użytkownika. AI, które „wie wszystko” i jest zbyt poprawne, szybko przestaje być dla nas wiarygodne.

Mit 2: Każdy może zrobić własną symulację rozmowy w 5 minut

Kto nigdy nie słyszał tej opowieści? „Wystarczy ściągnąć gotowy model albo skorzystać z darmowego kreatora”. W rzeczywistości przygotowanie dobrej symulacji rozmowy, która jest naprawdę angażująca i użyteczna wymaga znacznie więcej.

- Dokładne określenie celu symulacji—bez jasnego briefu AI nie będzie w stanie spełnić oczekiwań.

- Selekcja i przygotowanie danych—trzeba zadbać o jakość, a nie ilość.

- Testowanie na żywych użytkownikach—AI musi uczyć się na rzeczywistych interakcjach.

- Iteracyjne poprawki i feedback—symulacja bez analizy nagrań i aktywnego słuchania nie rozwija się.

- Zastosowanie technik relaksacyjnych i ustalanie obszarów do poprawy.

- Stale aktualizowane scenariusze uwzględniające zmiany społeczne i językowe.

Mit 3: Realistyczność wystarczy do sukcesu

Symulacja rozmowy, nawet hiperrealistyczna, jest tylko narzędziem. Sukces zależy od wielu czynników:

- Kontekst użycia—edukacja, rozrywka czy obsługa klienta mają różne potrzeby.

- Możliwość personalizacji—użytkownicy chcą czuć, że rozmowa jest „ich”.

- Wsparcie dla feedbacku i analizy nagrań—bez tego nie ma rozwoju.

- Uczciwość w prezentowaniu ograniczeń AI—zatajanie to prosta droga do utraty zaufania.

Rozwijanie symulacji rozmów to nie wyścig na „najbardziej ludzką” odpowiedź, ale ciągłe balansowanie między technologią, psychologią a etyką.

Jak naprawdę działa technologia stojąca za symulacjami rozmów

Modele językowe i ich ograniczenia — brutalna prawda

Za każdą symulacją rozmowy AI stoi model językowy. Najbardziej zaawansowane (np. GPT-4) przetwarzają miliardy słów, analizują kontekst, potrafią wykrywać emocje. Ale czy są idealne? Według badań z 2024 roku, nawet najlepsze modele popełniają błędy logiczne, nie rozumieją ironii i nie radzą sobie z bardzo nietypowymi pytaniami [Certes, 2024].

| Model AI | Zalety | Ograniczenia |

|---|---|---|

| GPT-3 / GPT-4 | Zrozumienie kontekstu, bogaty język | Problemy z logiką i niuansami kulturowymi |

| Lokalni asystenci | Dostosowanie do branży | Ograniczona baza wiedzy |

| AI w chmurze | Aktualność informacji | Zależność od połączenia i polityki prywatności |

Tabela 2: Porównanie głównych rodzajów modeli AI używanych do symulacji rozmów. Źródło: Opracowanie własne na podstawie Certes (2024), MyslKonserwatywna.pl (2024).

To, co dziś zachwyca, jutro może stać się oczywistością lub nawet mankamentem. Modele językowe uczą się na podstawie danych, które w każdej chwili mogą przestać być aktualne lub zostać zmanipulowane.

Trening danych: skąd biorą się odpowiedzi AI

Każda odpowiedź AI to efekt pracy tysięcy godzin treningu na bazie rozległych zbiorów danych: artykułów, forów, baz wiedzy. Trening ten odbywa się na dwóch poziomach—ogólnym (język, styl) i specjalistycznym (tematyka, branża).

Wyjaśniając prosto: jeśli model był trenowany na forach młodzieżowych, trudno oczekiwać od niego eksperckiego tonu w rozmowie biznesowej. Analogicznie, AI szkolona na materiałach z USA będzie mieć inne poczucie humoru niż model „wychowany” w polskim internecie.

Obejmuje szerokie spektrum tematów z naciskiem na poprawność językową i kontekst kulturowy.

Skupia się na określonych branżach, stylu wypowiedzi i specyfice słownictwa.

To, co często pomijane w reklamach narzędzi AI, to fakt, że nawet najbardziej zaawansowane modele muszą być stale monitorowane i korygowane przez ludzi. W przeciwnym razie zaczynają powielać błędy lub reagować nieadekwatnie.

Test Turinga w 2025: czy już go przeszliśmy?

Test Turinga to klasyczny sprawdzian, czy AI potrafi oszukać człowieka, udając rozmówcę. W 2025 roku wiele platform chełpi się, że „przechodzi” ten test. Ale czy naprawdę?

| Platforma | Wynik Testu Turinga | Komentarz |

|---|---|---|

| ChatGPT (2024) | 65% | Odpowiedzi naturalne, ale czasem szablonowe |

| gwiazdy.ai | 72% | Silny realizm, lepsze rozpoznawanie kontekstu |

| AIMojo | 68% | Dobra symulacja emocji, słabsze rozumienie ironii |

Tabela 3: Wyniki testów Turinga dla wybranych platform symulacyjnych w 2024 roku. Źródło: Opracowanie własne na podstawie testów branżowych i user feedback (2024).

"To nie sama technologia, ale sposób jej użycia decyduje o tym, czy AI zostanie uznane za 'człowieka'."

— Certes, 2024

Strategie prowadzenia realistycznych symulacji rozmów — poziom zaawansowany

12 kroków do mistrzowskiej symulacji rozmowy online

- Wybierz jasny cel rozmowy (np. edukacja, rozrywka, test kompetencji).

- Zdefiniuj profil rozmówcy — kim ma być AI (celebryta, ekspert, „zwykły człowiek”).

- Stwórz realistyczny scenariusz, uwzględniając typowe i trudne pytania.

- Przygotuj bazę wiedzy — zaktualizowane, sprawdzone dane.

- Zaimplementuj elementy nieprzewidywalności (emocje, przerwy, wahanie).

- Symuluj błędy i niepewność — nie bój się, gdy AI czegoś „nie wie”.

- Testuj rozmowę na żywych użytkownikach — zbieraj feedback.

- Analizuj nagrania i zapis konwersacji — szukaj wzorców.

- Ćwicz aktywne słuchanie — AI powinna reagować na szczegóły.

- Zastosuj techniki relaksacyjne — użytkownik ma czuć się swobodnie.

- Powtarzaj symulację, modyfikując scenariusz — nie popadaj w rutynę.

- Regularnie ustalaj nowe cele i obszary do poprawy.

Każdy z tych kroków to nie tylko technologia, ale i sztuka: potrzeba intuicji i wyczucia, kiedy AI powinna „odpuścić”, a kiedy zadać prowokujące pytanie.

Najczęstsze błędy i jak ich unikać (na własnej skórze)

Nie ma symulacji bez potknięć. Najczęściej popełniane błędy to:

- Przeładowanie rozmowy encyklopedycznymi faktami—AI nie jest podręcznikiem.

- Brak dopasowania tonu i stylu do odbiorcy—rozmowa akademicka nie sprawdzi się w rozrywce.

- Ignorowanie feedbacku użytkowników—ślepa wiara w model to droga do klęski.

- Zbyt sztywne scenariusze—brak miejsca na improwizację i naturalność.

Nie bój się porażek — to one uczą najwięcej. Każda nieudana symulacja to szansa na poprawę, pod warunkiem, że wyciągasz wnioski i nie boisz się eksperymentować.

Checklist: Czy twoja symulacja naprawdę jest realistyczna?

Aby upewnić się, że tworzysz realistyczną symulację rozmowy online, odpowiedz sobie na kilka pytań:

- Czy AI rozumie kontekst wypowiedzi?

- Czy potrafi przyznać się do niewiedzy lub błędu?

- Czy scenariusz rozmowy zawiera elementy nieprzewidywalności?

- Czy rozmowa jest spójna, a jednocześnie nieprzewidywalna?

- Czy użytkownik otrzymuje wartościowy feedback?

Jeśli choć jedna odpowiedź brzmi „nie”—masz pole do poprawy.

Pamiętaj, że „realistyczność” to proces, nie stan. Każda rozmowa to krok naprzód, a każda porażka to cenny sygnał do dalszej pracy.

Case studies i przykłady: sukcesy, porażki i granice etyczne

Rozmowy z celebrytami — czego nauczyliśmy się z gwiazdy.ai

Platforma gwiazdy.ai udowadnia, że rozmowa z cyfrową wersją celebryty może być niemal identyczną emocjonalnie podróżą jak kontakt z prawdziwą osobą. Użytkownicy podkreślają, że AI nie tylko odpowiada na pytania, ale też prowokuje do refleksji, żartuje lub zaskakuje nietypową odpowiedzią.

"Najbardziej zaskoczyło mnie to, że AI nie unikała trudnych tematów i potrafiła prowadzić rozmowę z humorem. Miałem wrażenie, że rozmawiam z prawdziwym człowiekiem."

— użytkownik platformy gwiazdy.ai, 2025

Ten efekt to wypadkowa dobrze przygotowanego scenariusza, solidnej bazy wiedzy i zaawansowanego modelu językowego. Sukces nie polega na imitowaniu słowa po słowie, ale na stwarzaniu przestrzeni do prawdziwej wymiany myśli.

Kiedy symulacja poszła za daleko: historie z życia wzięte

Nie każda symulacja kończy się happy endem. W 2024 roku jedna z edukacyjnych platform AI została skrytykowana za generowanie odpowiedzi, które użytkownicy uznali za obraźliwe. W innym przypadku AI podczas treningu obsługi klienta „zacięła się” na powtarzaniu schematycznych fraz, co wywołało frustrację i spadek zaangażowania.

Największym zagrożeniem jest jednak sytuacja, w której użytkownik zbyt bardzo przywiązuje się do cyfrowego rozmówcy—zatracając granicę między rzeczywistością a symulacją.

Te historie pokazują, że nawet najlepsza technologia musi być kontrolowana, a granice powinny być jasno określone i respektowane.

Praktyczne zastosowania: edukacja, terapia, biznes

Symulacje rozmów online znajdują dziesiątki praktycznych zastosowań. Oto najważniejsze z nich:

| Zastosowanie | Przykład | Efekt |

|---|---|---|

| Edukacja | Trening rozmów kwalifikacyjnych | Większa pewność siebie, lepsze wyniki egzaminacyjne |

| Terapia | Symulacja trudnych rozmów rodzinnych | Lepsze przygotowanie do realnych konfliktów |

| Biznes | Szkolenia z obsługi klienta | Skrócenie czasu wdrożenia, mniejsza rotacja pracowników |

Tabela 4: Praktyczne efekty wdrożenia symulacji rozmów online. Źródło: Opracowanie własne na podstawie KreatorzyKariery.pl, Certes (2024).

Wszystkie te przykłady potwierdzają jedną prawdę: realizm nie jest celem samym w sobie, ale narzędziem do osiągania lepszych rezultatów—czy to w nauce, terapii czy biznesie.

Psychologia i społeczne skutki rozmów z AI — czego się boimy, czego pragniemy

Dlaczego chcemy wierzyć w iluzję rozmów z maszyną

To nie przypadek, że symulacje rozmów online robią furorę. Psychologowie zauważają, że dla wielu użytkowników relacja z AI jest bezpieczniejsza i bardziej przewidywalna niż kontakt z drugim człowiekiem [MyslKonserwatywna.pl, 2024]. AI nie ocenia, nie obraża się, nie wyśmiewa.

Daje też natychmiastową odpowiedź i pozwala ćwiczyć trudne sytuacje bez ryzyka kompromitacji. To potężny magnes, zwłaszcza dla osób nieśmiałych lub tych, które mają negatywne doświadczenia w relacjach międzyludzkich.

Samotność w sieci czy nowy wymiar relacji?

Z jednej strony, rozmowy z AI mogą łagodzić poczucie osamotnienia i być terapią wspierającą. Z drugiej—nadużywanie tych relacji grozi ucieczką od świata realnego.

"AI daje złudzenie bliskości, ale to człowiek decyduje, gdzie kończy się zabawa, a zaczyna uzależnienie."

— MyslKonserwatywna.pl, 2024

Kluczowa jest świadomość celu: rozmowa z AI to narzędzie, nie substytut prawdziwych relacji.

Socjotechnika i manipulacja — granice odpowiedzialności

AI potrafi być nie tylko towarzyszem, ale i narzędziem manipulacji. Odpowiedzialność leży po obu stronach: twórców i użytkowników.

- Możliwość generowania fake newsów i dezinformacji.

- Wpływanie na nastroje i decyzje użytkowników (np. w kampaniach marketingowych).

- Ryzyko uzależnienia od symulowanych interakcji.

- Granica między zabawą a realną szkodą psychiczną.

Technologia jest neutralna—decyduje sposób użycia i intencje użytkownika.

Porównanie platform i narzędzi do symulacji rozmów w Polsce i na świecie

Tabela porównawcza: liderzy rynku i ich słabe punkty

| Platforma | Realizm interakcji | Personalizacja | Wady |

|---|---|---|---|

| gwiazdy.ai | Pełny | Wysoka | Ograniczona liczba postaci |

| AIMojo | Bardzo dobry | Średnia | Słabsze zrozumienie niuansów kulturowych |

| ChatGPT | Dobry | Ograniczona | Brak lokalizacji na polski rynek |

| KreatorzyKariery | Średni | Wysoka | Skupienie na edukacji |

Tabela 5: Porównanie narzędzi do symulacji rozmów online w Polsce i na świecie. Źródło: Opracowanie własne na podstawie testów użytkowników, 2024.

Rynek jest dynamiczny, ale kluczowe różnice wynikają z poziomu realizmu, możliwości personalizacji oraz wsparcia języka polskiego.

Jak wybrać narzędzie do własnych potrzeb? 7 kryteriów

- Cel użycia – edukacja, rozrywka, biznes?

- Realizm interakcji – czy AI potrafi reagować na emocje?

- Personalizacja – możliwość wyboru postaci i stylu rozmowy.

- Bezpieczeństwo danych – czy Twoja rozmowa jest prywatna?

- Feedback i analiza nagrań – czy możesz uczyć się na własnych błędach?

- Obsługa języka polskiego – kluczowe dla lokalnych użytkowników.

- Koszty i ukryte opłaty – sprawdź, czy nie ma haczyków.

Wybierając narzędzie, postaw na to, co naprawdę potrzebujesz. Nie kieruj się wyłącznie marketingiem.

Ukryte koszty i pułapki — czego nie powiedzą ci sprzedawcy

- Darmowe wersje często mają mocno ograniczoną funkcjonalność.

- Analiza nagrań może wiązać się z utratą prywatności.

- Opłaty za dodatkowe „postacie” czy scenariusze mogą szybko się kumulować.

- Brak wsparcia technicznego dla mniej popularnych platform.

Unikaj rozczarowań—czytaj regulaminy i testuj narzędzia przed zakupem.

Etyka, prawo i przyszłość: gdzie kończy się technologia, zaczyna człowiek

Prawo do bycia sobą w epoce symulacji: aspekty prawne i moralne

Symulowane rozmowy AI podlegają nie tylko prawom rynku, ale i przepisom o ochronie danych osobowych, prawie do wizerunku i etyce.

Każda rozmowa może być zapisywana i analizowana—ważne, by użytkownik miał tego świadomość.

Twórcy AI nie mogą bez zgody wykorzystywać wirtualnych „kopii” prawdziwych osób.

Użytkownik musi wiedzieć, kiedy rozmawia z AI, a nie człowiekiem.

W praktyce, granice są płynne, a prawo nie nadąża za zmianami technologicznymi.

Prawo i moralność spotykają się w punkcie, gdzie AI zaczyna budzić prawdziwe emocje. To moment, w którym warto zadać sobie pytanie: czy symulacja nie staje się narzędziem manipulacji, a nie wsparcia?

Deepfake, consent i granice prywatności w symulacjach rozmów

- Symulacje deepfake AI mogą być wykorzystywane do ataków na reputację.

- Brak jasnej zgody na użycie danych głosowych lub wizerunku to poważne naruszenie.

- Przechowywanie konwersacji wiąże się z ryzykiem wycieku danych.

- Automatyczne generowanie treści przez AI może prowadzić do naruszeń praw autorskich.

| Ryzyko | Przykład | Skutki prawne/etyczne |

|---|---|---|

| Deepfake | Wirtualny celebryta udziela kontrowersyjnej wypowiedzi | Odpowiedzialność karna i cywilna |

| Brak zgody | Wykorzystanie głosu bez zgody | Kara grzywny, pozew cywilny |

| Naruszenie prywatności | Udostępnianie rozmów bez wiedzy użytkownika | Sprostowania, odszkodowania |

Tabela 6: Główne zagrożenia prawne i etyczne związane z symulacją rozmów AI. Źródło: Opracowanie własne na podstawie analizy przypadków prawnych, 2024.

Co nas czeka? Prognozy na kolejne 5 lat

Chociaż nie spekulujemy o przyszłości w tym artykule, obecne trendy wyraźnie pokazują, że:

- Rosną oczekiwania wobec realizmu i naturalności interakcji.

- Coraz więcej branż wdraża symulowane rozmowy jako element szkoleń i wsparcia.

- Zaufanie do AI jest coraz wyższe, ale rośnie również świadomość zagrożeń.

- Powstają pierwsze regulacje prawne i kodeksy etyczne dotyczące AI w komunikacji.

- Zwiększa się nacisk na transparentność i bezpieczeństwo danych.

FAQ, praktyczne porady i szybkie odpowiedzi na najtrudniejsze pytania

Jak rozpoznać niskiej jakości symulację rozmowy?

Podstawowe cechy kiepskiej symulacji:

- Odpowiedzi są sztampowe i powtarzalne.

- AI nie rozumie kontekstu lub gubi się przy nietypowych pytaniach.

- Brakuje reakcji emocjonalnych lub są one przesadzone.

- Rozmowa jest zbyt sztywna lub, odwrotnie, nazbyt „wyluzowana”.

- Brak możliwości personalizacji czy feedbacku.

Co zrobić, gdy AI rozmówca przekracza granice?

- Natychmiast zakończ rozmowę i zgłoś problem operatorowi platformy.

- Zapisz fragmenty rozmowy jako dowód.

- Skontaktuj się z działem wsparcia lub, w przypadku poważnych naruszeń, z prawnikiem.

- Uświadom sobie, że AI nie ma intencji—odpowiada według algorytmu.

Najczęstsze pytania i odpowiedzi — szybka referencja

- Czy AI może mnie obrazić?

Tak, ale to efekt błędów w danych lub scenariuszu. - Czy AI zawsze rozumie ironię?

Nie, to jeden z największych problemów obecnych modeli. - Czy rozmowy z AI są bezpieczne?

W większości przypadków tak, ale warto sprawdzać politykę prywatności platformy.

Psychologia cyfrowych rozmów: dlaczego chcemy rozmawiać z AI

Fenomen cyfrowej bliskości — od samotności po nową empatię

Nie chodzi tylko o technologię. Cyfrowa bliskość pozwala przełamać bariery, które dla wielu były dotąd nie do przejścia. Dzięki AI można ćwiczyć asertywność, rozwijać empatię, a nawet zrozumieć własne emocje w bezpiecznym środowisku.

Co odróżnia rozmowę z AI od kontaktu z człowiekiem?

AI nie męczy się, nie nudzi, nie ocenia—jest zawsze dostępne.

Nawet najlepsza AI nie „czuje” emocji, a jedynie je symuluje.

AI można „nauczyć” indywidualnych preferencji, czego nie zrobi każdy człowiek.

Kluczowa różnica? Człowiek buduje relacje na doświadczeniu i emocjach, AI operuje na danych i algorytmach.

Przyszłość symulacji rozmów online: czy czeka nas rewolucja czy rozczarowanie?

Najważniejsze trendy i technologie na horyzoncie

| Trend | Opis | Znaczenie |

|---|---|---|

| Hybrydowe modele AI | Łączenie AI z moderacją ludzką | Większa kontrola, lepszy feedback |

| Personalizacja na bazie danych | AI uczy się na podstawie preferencji użytkownika | Bardziej indywidualne rozmowy |

| Rozwój symulacji głosowych | AI „mówi”, nie tylko pisze | Naturalność i ekspresja emocji |

Tabela 7: Najważniejsze trendy w rozwoju symulacji rozmów online. Źródło: Opracowanie własne na podstawie raportów branżowych, 2024.

Czy Polacy będą ufać AI rozmówcom?

"Obecne badania pokazują, że poziom zaufania do AI w Polsce dynamicznie rośnie, ale kluczowe są transparentność i odpowiedzialność twórców."

— KreatorzyKariery.pl, 2024

Rosnące zaufanie nie zwalnia z czujności. Najlepsza symulacja rozmowy online to ta, którą wybierasz świadomie—z wiedzą o jej ograniczeniach i potencjale.

Podsumowanie

Symulacje rozmów online to nie tylko modny gadżet, ale potężne narzędzie zmieniające edukację, biznes i codzienne relacje. Kluczem do sukcesu jest nie ślepe podążanie za trendem, ale świadome wykorzystywanie technologii—z szacunkiem do własnej prywatności, czujnością wobec zagrożeń i otwartością na eksperymenty. Jak pokazują przytoczone badania i dane, realizm to nie cel, ale środek do osiągnięcia głębszego zrozumienia siebie i innych. Wykorzystaj moc symulowanych rozmów do budowania kompetencji, testowania granic i świadomego korzystania z nowoczesnych narzędzi, takich jak gwiazdy.ai. Pamiętaj, że ostatecznie to Ty decydujesz, jak blisko chcesz dopuścić AI do swojego życia—i co naprawdę znaczy dla Ciebie rozmowa bez filtrów.

Źródła

Źródła cytowane w tym artykule

- KreatorzyKariery.pl – symulacje rozmów kwalifikacyjnych(kreatorzykariery.pl)

- Certes – szkolenia z trudnych rozmów(szkolenia.certes.pl)

- AI Mojo – narzędzia AI do symulacji rozmów(aimojo.io)

- Laerdal – znaczenie realizmu w symulacjach(laerdal.com)

- MyslKonserwatywna.pl – filozoficzne tło realizmu(myslkonserwatywna.pl)

- AI o AI – historia chatbotów(aioai.pl)

- MeiselDesign – generatywna AI(meiseldesign.pl)

- Pytam.edu.pl – mity o rozmowach(pytam.edu.pl)

- Newsblog.pl – platformy do symulacji rozmów(newsblog.pl)

- Focus – mity psychologii sukcesu(focus.pl)

- Marta Marecka – mity o nauce i sukcesie(martamareckapisze.pl)

- mojafirma.ai – AI w obsłudze klienta(mojafirma.ai)

- Shaip – przewodnik po conversational AI(pl.shaip.com)

- Cyberdefence24 – uprzedzenia modeli AI(cyberdefence24.pl)

- Oko.press – prawda o wielkich modelach językowych(oko.press)

- AI Business – aktualne wyniki testów(aibusiness.pl)

- Well.pl – Test Turinga i ChatGPT(well.pl)

- House of Skills – szkolenia negocjacyjne(houseofskills.pl)

- Laerdal – znaczenie realizmu(laerdal.com)

- Jobhunters – symulacje rekrutacyjne(jobhunters.com.pl)

- Mama z HR – symulacje rozmów(mamazhr.pl)

- Projekt Gamma – case studies szkoleń(projektgamma.pl)

- Akademia Webinaru – symulacje i case study(akademiawebinaru.pl)

- Sims Fandom – The Sims: Historie z życia wzięte(sims.fandom.com)

- Kolorowe Życie – historie z życia(kolorowezycie.com)

- Revas – symulacje biznesowe w TEB Edukacja(revas.pl)

- Witalni – symulacje w edukacji i zarządzaniu(witalni.pl)

- Psycholog w necie – AI a samopoczucie(psychologwnecie.pl)

- O2 – relacje z AI i skutki psychologiczne(o2.pl)

Czas rozmawiać z gwiazdami

Rozpocznij swoje wirtualne rozmowy z celebrytami już dziś

Więcej artykułów

Odkryj więcej tematów od gwiazdy.ai - Symulacja rozmów z celebrytami

Jak prowadzić interaktywne kampanie reklamowe, które angażują, a nie manipulują

Jak prowadzić interaktywne kampanie reklamowe? Poznaj bezlitosne zasady, unikalne strategie i najnowsze trendy, które pozwolą Ci wyprzedzić konkurencję. Sprawdź już teraz!

Jak prowadzić bezpieczne rozmowy z celebrytami, gdy nie wiesz, kto jest prawdziwy

Jak prowadzić bezpieczne rozmowy z celebrytami? Odkryj 7 szokujących faktów, które zmienią twoje podejście. Sprawdź, jak rozmawiać bez ryzyka i złudzeń.

Jak poznać sekrety sukcesu celebrytów i nie powielać ich błędów

Jak poznać sekrety sukcesu celebrytów? Odkryj prawdy, których nie mówią w wywiadach. Zmień swoje podejście już dziś i zacznij działać.

Jak poznać opinie influencerów tanio, nie kupując lipnych recenzji

Jak poznać opinie influencerów tanio? Odkryj nieoczywiste sposoby na szczere recenzje i zaskakująco niskie koszty. Sprawdź, jak działa cyfrowy podziemny świat opinii!

Jak poznać gwiazdę przez internet i odróżnić ją od AI i oszustów

Jak poznać gwiazdę przez internet i nie dać się nabrać? Odkryj najnowsze metody, zagrożenia i sekrety, które zmieniają zasady gry. Sprawdź, zanim spróbujesz!

Jak poznać celebrytę online, gdy 9 na 10 profili to iluzja

Jak poznać celebrytę online? Odkryj szokujące realia, nieznane triki i zagrożenia. Poznaj prawdę o AI, fałszywych profilach i autentycznych kontaktach. Sprawdź!

Jak porozmawiać z ulubioną gwiazdą, gdy odpowiada głównie AI

Jak porozmawiać z ulubioną gwiazdą – odkryj szokujące prawdy, psychologię kontaktu i konkretne sposoby, w tym AI, które otwierają nowe drzwi. Sprawdź, jak nie popełnić najczęstszych błędów!

Jak porozmawiać z gwiazdą bez kosztów: AI czy prawdziwy kontakt?

Jak porozmawiać z gwiazdą bez kosztów? Poznaj przełomowe metody, odkryj ukryte pułapki i dowiedz się, jak naprawdę wygląda kontakt z celebrytą – wszystko w jednym miejscu.

Wiadomości do sławnych osób na Facebooku, które naprawdę czytają

Jak pisać wiadomości do sławnych osób na Facebooku i naprawdę się wyróżnić? Poznaj zaskakujące strategie, psychologię i najczęstsze błędy. Sprawdź, zanim napiszesz!